Midjourney, DALL-E, Stable Diffusion, Craiyon… η αλματώδης πρόοδος της τεχνητής νοημοσύνης (ΤΝ) τους τελευταίους μήνες έχει προκαλέσει ένα νέο φαινόμενο: τη μαζική κοινοποίηση στα κοινωνικά δίκτυα τεχνητά παραγόμενων εικόνων. Ορισμένες από αυτές τις εικόνες, οι οποίες είναι εξαιρετικά ρεαλιστικές και προέρχονται από την επικαιρότητα και μερικές φορές παρουσιάζονται ως αυθεντικές, έχουν προκαλέσει σύγχυση. Παρόλο που δεν υπάρχει προς το παρόν κανένα εργαλείο ικανό να εντοπίσει με βεβαιότητα μια τεχνητά παραγόμενη εικόνα, η αναζήτηση του περιεχομένου του στιγμιότυπου και ο εντοπισμός οπτικών ασυμβατοτήτων μπορεί να συμβάλει στον εντοπισμό μιας εικόνας ΤΝ, δήλωσαν ειδικοί στον τομέα αυτό στο AFP.

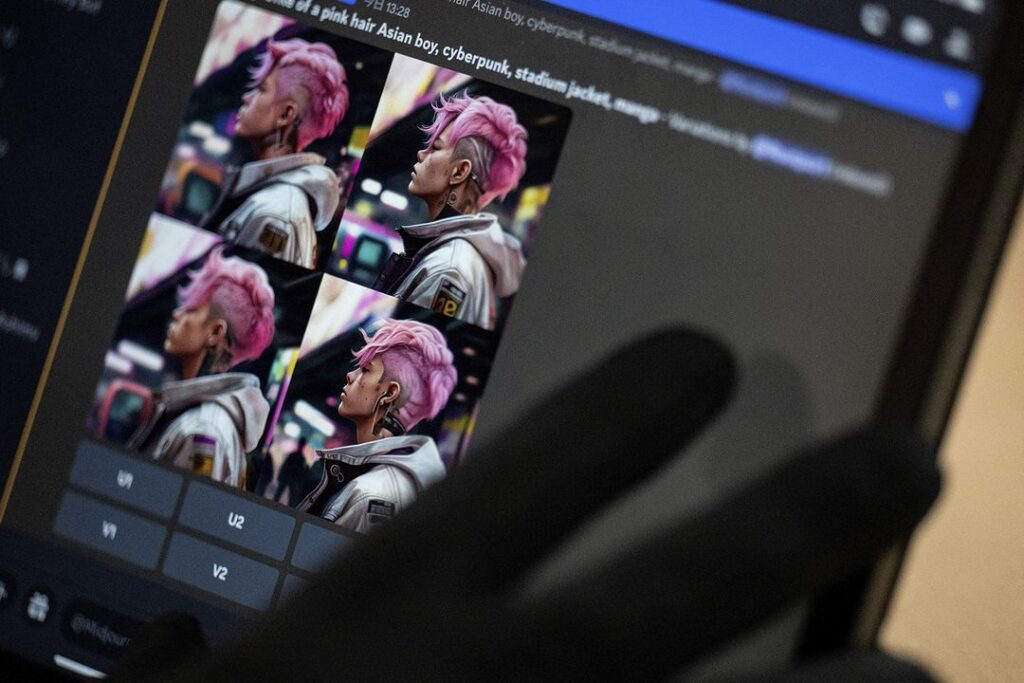

Η περιγραφή μιας εικόνας με λέξεις-κλειδιά είναι η βασική αρχή που διέπει πολλές ψηφιακά προγράμματα TN, όπως η Midjourney, η DALL-E, η Craiyon και η Stable Diffusion. Αυτά τα εργαλεία είναι ικανά να παράγουν έναν άπειρο αριθμό εικόνων από μια τεράστια βάση δεδομένων που τροφοδοτείται συνεχώς από τα αιτήματα των χρηστών.

Πως μπορούμε να τις αναγνωρίσουμε; Πολλοί χρήστες του Διαδικτύου χρησιμοποιούν εικόνες ΤΝ για χιουμοριστικά ή καλλιτεχνικά έργα, αλλά άλλοι έχουν επιλέξει να συνδέσουν αυτές τις εικόνες με πολιτικές και διεθνείς ειδήσεις, όπως το παράδειγμα της εικόνας του πυροσβέστη της ΕΜΑΚ μετά τον καταστροφικό σεισμό στην Τουρκία.

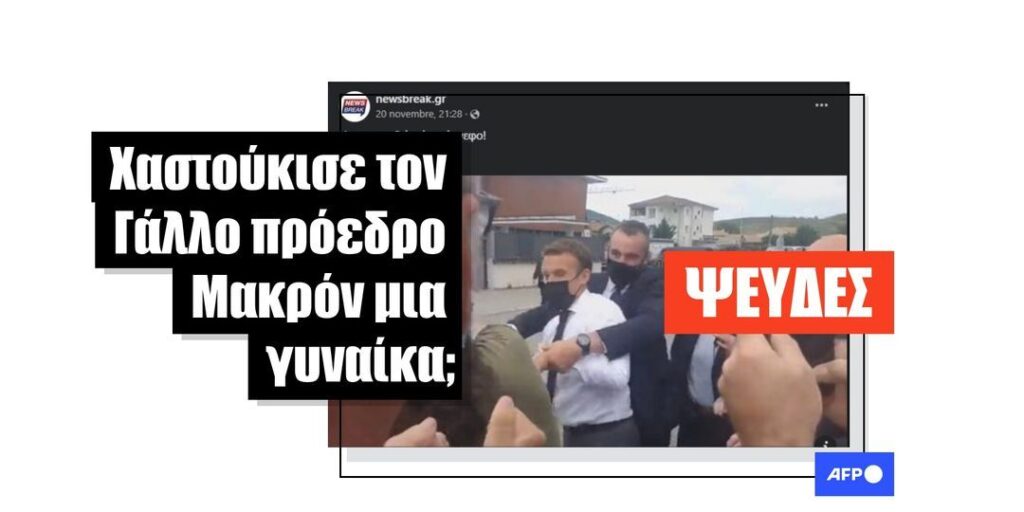

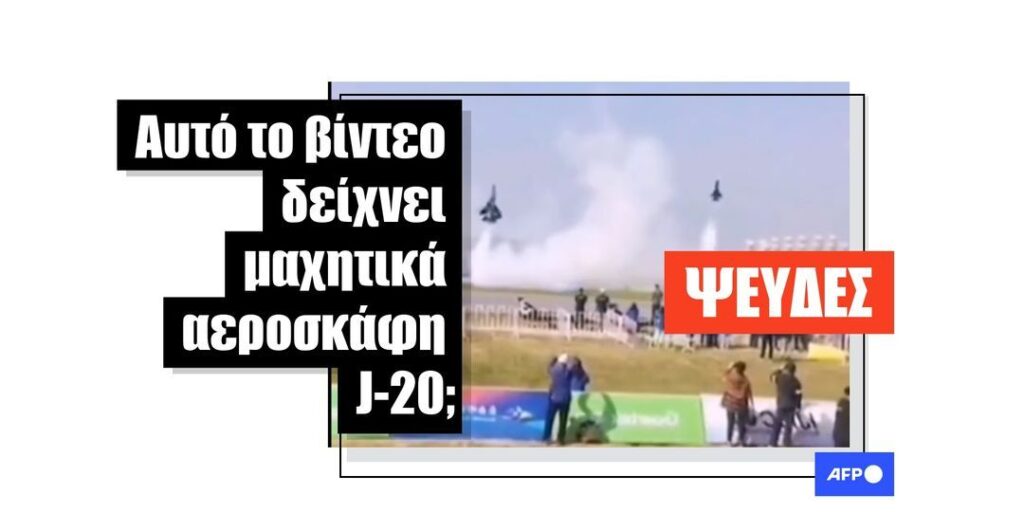

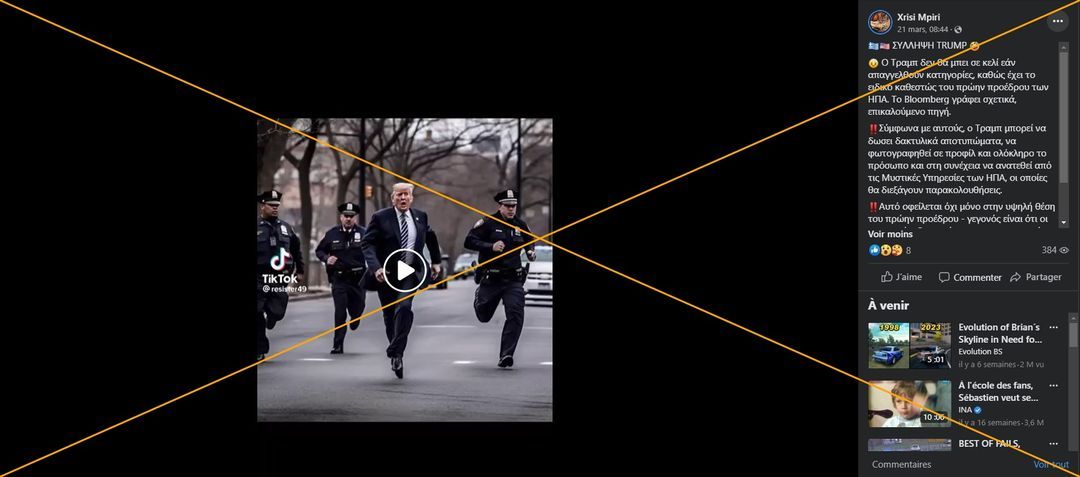

Τον Μάρτιο κυκλοφόρησαν στο Facebook εικόνες που δημιουργήθηκαν με ΤΝ και απεικόνιζαν τη φανταστική «σύλληψη» του πρώην προέδρου των ΗΠΑ Ντόναλντ Τραμπ. Άλλες εικόνες κυκλοφόρησαν στο Twitter για να απεικονίσουν αυθεντικά γεγονότα, όπως η συνάντηση μεταξύ του Βλαντιμίρ Πούτιν και του Σι Τζινπίνγκ (αρχειοθετημένο εδώ) στις 20 Μαρτίου 2023, ή για να απεικονίσουν φανταστικές καταστάσεις, όπως τον Εμανουέλ Μακρόν ως σκουπιδιάρη ή ως αστυνομικό των ΜΑΤ (CRS, στην Γαλλία), κατά τη διάρκεια διαδηλώσεων κατά της συνταξιοδοτικής μεταρρύθμισης στη Γαλλία.

Στιγμιότυπο της παραπλανητικής ανάρτησης στο Facebook. Λήψη εικόνας: 29/03/2023

Hi, I’m a tech reporter that covers China, cybersecurity, & new media. Hundreds of people are sharing this photo of Xi Jinping & Vladimir Putin as they meet at the Kremlin. The two did meet, but it’s highly likely this photo was generated by an AI program. Here’s why: pic.twitter.com/6xqsDLxiMa

— Amanda Florian 小爱 (@Amanda_Florian)

March 21, 2023

L’#ia#photo a fait des progrès démentiels en très peu de temps, désormais le #fake sera la norme sur les #reseaux, doutez de ce que vous voyez par défaut, plus le choix.#midjourney#midjourneyv5pic.twitter.com/dJoZXGrbRy

— Cryptonoo₿ From 100K to 0 (@Cryptonoobzzzz)

March 19, 2023

Παρόλο που η πλειοψηφία των δημιουργών αυτών των εικόνων διευκρινίζει ότι πρόκειται για ψεύτικες, οι εικόνες αυτές έχουν ευρέως κυκλοφορήσει, κοινοποιούνται συχνά εκτός νοηματικού πλαισίου ή παρουσιάζονται ακόμη και ως αυθεντικές.

Υπάρχουν εργαλεία που έχουν δημιουργηθεί ή εξακολουθούν να αναπτύσσονται για να προσπαθούν να ανιχνεύσουν αυτά τα μοντάζ, όπως αυτό εδώ, αλλά τα αποτελέσματά τους εξακολουθούν να είναι συγκεχυμένα και μάλιστα μερικές φορές μπορεί να είναι παραπλανητικά, σύμφωνα με δοκιμές που πραγματοποίησε το AFP.

«Όταν μια μηχανή της ΤΝ δημιουργεί μια ολόκληρη εικόνα, συνήθως δεν παίρνει τμήματα μιας μεμονωμένης φωτογραφίας. Χρησιμοποιούνται χιλιάδες ή ακόμη και εκατομμύρια φωτογραφίες έτσι ώστε να λαμβάνονται υπόψη δισεκατομμύρια παράμετροι», δήλωσε στο AFP στις 21 Μαρτίου ο Ντέιβιντ Φίσινγκερ, μηχανικός στο Αυστριακό Ινστιτούτο Τεχνολογίας και ειδικός στην ΤΝ.

«Η ΤΝ ανακατεύει αυτές τις φωτογραφίες από τη βάση δεδομένων της, τις αποδομεί και στη συνέχεια ανακατασκευάζει μια εικόνα πίξελ προς πίξελ, πράγμα που σημαίνει ότι στην τελική απεικόνιση δεν παρατηρείται πλέον η διαφορά μεταξύ των αρχικών εικόνων», δήλωσε στο AFP στις 21 Μαρτίου ο Βίνσεντ Τεράσι, συνιδρυτής της Draft & Goal, μιας νεοφυούς επιχείρησης (startup) που έχει ξεκινήσει έναν ανιχνευτή περιεχομένου που δημιουργείται από τεχνητή νοημοσύνη για πανεπιστήμια.

Για τον λόγο αυτό, το λογισμικό που είναι ικανό να ανιχνεύει φωτομοντάζ δεν θα λειτουργεί ή η λειτουργία του θα είναι πολύ ελλιπής όσον αφορά την ανίχνευση εικόνων που έχουν παραχθεί εξ ολοκλήρου από ΤΝ.

Τα μεταδεδομένα μιας φωτογραφίας, η ψηφιακή ταυτότητα ενός αρχείου, η οποία μπορεί μερικές φορές να αποκαλύψει τον ιστότοπο από τον οποίο προήλθε μια εικόνα που δημιουργήθηκε από ΤΝ, δεν είναι επίσης χρήσιμα για ένα «viral shot»: «δυστυχώς, δεν μπορείτε να βασιστείτε σε αυτά τα εργαλεία, επειδή τα κοινωνικά δίκτυα διαγράφουν συστηματικά αυτές τις πληροφορίες», επεσήμανε στο AFP στις 23 Μαρτίου η Ανναλίζα Βερντόλιβα, καθηγήτρια στο Πανεπιστήμιο Federico II της Νάπολης και ειδικός σε θέματα ΤΝ.

Εντοπίζοντας την πηγή της εικόνας

Σύμφωνα με τους ειδικούς, ένας τρόπος για να εντοπιστεί η δημιουργία μιας εικόνας ΤΝ είναι, επομένως, να βρεθεί το αρχικό της πλαίσιο, για να διαπιστωθεί αν ένας διαδικτυακός χρήστης εξηγεί, όπως συμβαίνει συχνά, ότι τη δημιούργησε και ποιο εργαλείο χρησιμοποίησε.

Αυτό σημαίνει ότι πρέπει να προσπαθήσουμε να εντοπίσουμε την πρώτη φορά που η φωτογραφία κοινοποιήθηκε στο διαδίκτυο.

Αυτό μπορεί να γίνει μέσω μιας αντίστροφης αναζήτησης εικόνας, εισάγοντας την εικόνα σε μία ή περισσότερες μηχανές αναζήτησης για να δούμε αν μπορει να βρεθεί η εικόνα και να προσπαθήσουμε να βρούμε παλιές δημοσιεύσεις της.

Η μέθοδος αυτή καθιστά δυνατή, για παράδειγμα, τον προσδιορισμό της πηγής των εικόνων που κυκλοφόρησαν ευρέως στα κοινωνικά δίκτυα και απεικονίζουν την βίαιη συμπλοκή μεταξύ του πρώην προέδρου των ΗΠΑ Ντόναλντ Τραμπ και των αστυνομικών που τον συνέλαβαν.

Μια αντίστροφη αναζήτηση εικόνας στο Google σε μία από αυτές τις εικόνες οδηγεί σε ένα tweet του Έλιοτ Χίγκινς, ιδρυτή του ερευνητικού ιστότοπου Bellingcat, το οποίο δημοσιεύθηκε στις 20 Μαρτίου 2023.

Ο ίδιος εξηγεί σε ένα thread ότι δημιούργησε αυτή τη σειρά εικόνων που δείχνουν τη «σύλληψη» του Ντόναλντ Τραμπ, χρησιμοποιώντας την τελευταία έκδοση του Midjourney.

Making pictures of Trump getting arrested while waiting for Trump’s arrest. pic.twitter.com/4D2QQfUpLZ

— Eliot Higgins (@EliotHiggins)

March 20, 2023

Εάν η αρχική φωτογραφία δεν μπορεί να βρεθεί, η αντίστροφη αναζήτηση εικόνας μπορεί επίσης να οδηγήσει σε μια καλύτερη ποιοτική έκδοση της φωτογραφίας, εάν έχει περικοπεί, τροποποιηθεί ή χάσει σε ποιότητα στην πορεία της κοινοποίησης. Όσο καλύτερη είναι η ποιότητα της εικόνας, τόσο ευκολότερη θα είναι η ανάλυσή της για σφάλματα επεξεργασίας.

Τέλος, η αντίστροφη αναζήτηση εικόνας έχει το πλεονέκτημα της ανάδειξης παρόμοιων εικόνων. Αυτό μπορεί να είναι χρήσιμο όταν συγκρίνετε μια φωτογραφία για την οποία υπάρχει υποψία ότι δημιουργήθηκε από τεχνητή νοημοσύνη με φωτογραφίες από αξιόπιστες πηγές.

Στο πλαίσιο της συνάντησης μεταξύ του Βλαντίμιρ Πούτιν και του Σι Τζινπίνγκ, κυκλοφόρησε στο διαδίκτυο μια φωτογραφία χωρίς πηγή που έδειχνε τον Ρώσο πρόεδρο να γονατίζει μπροστά στον Κινέζο ηγέτη.

Ωστόσο, ο ιταλός δημοσιογράφος Νταβίντ Πουέντε επεσήμανε ότι το σκηνικό σε αυτή την εικόνα ήταν πολύ διαφορετικό από αυτό σε άλλες εικόνες των μέσων ενημέρωσης που κάλυπταν το γεγονός, προκαλώντας αμφιβολίες για την αυθεντικότητα της viral φωτογραφίας.

Η περιγραφή μιας φωτογραφίας και τα σχόλια άλλων χρηστών μπορούν επίσης να είναι πολύ χρήσιμα για να επισημάνετε ένα μοντάζ ή να αναγνωρίσετε το στυλ μιας εικόνας ΤΝ, ενώ το DALL-E είναι για παράδειγμα γνωστό για τα υπερρεαλιστικά του σχέδια και το Midjourney για το στήσιμο διασημοτήτων.

Αυτό μπορεί να είναι χρήσιμο για να μεταβείτε στο εργαλείο που δημιούργησε την εικόνα και να προσπαθήσετε να βρείτε τη δημιουργία. Σε ορισμένα προγράμματα, όπως το Midjourney, μια ενδελεχής αναζήτηση των ανταλλαγών μεταξύ των χρηστών και του αυτόματου προγράμματος μπορεί να βοηθήσει στην εύρεση των φωτογραφιών που δημιουργήθηκαν.

Εάν η πηγή της εικόνας δεν μπορεί να βρεθεί και δεν υπάρχει καμία ένδειξη για το περιεχόμενό της, είναι απαραίτητο να εξετάσετε την ίδια την εικόνα.

Αναλύοντας την εικόνα

- Αναζητώντας μια «υπογραφή»

Μερικές φορές, τα στοιχεία αναγνώρισης κρύβονται στη φωτογραφία: ορισμένοι ιστότοποι μπορούν να τοποθετήσουν ένα είδος υπογραφής στα έργα τους. Αυτό συμβαίνει με το DALL-E, το οποίο δημιουργεί αυτόματα μια πολύχρωμη μπάρα στο κάτω δεξιά μέρος όλων των εικόνων του, ή με το Crayion, το οποίο τοποθετεί ένα μικρό κόκκινο μολύβι στο ίδιο σημείο.

Πάντως δεν εμφανίζουν όλα τα προγράμματα ΤΝ ένα διακριτικό σήμα στις εικόνες τους και αυτό μπορεί να έχει αφαιρεθεί κατά τη μεταφόρτωση της φωτογραφίας ή να έχει αργότερα περικοπεί ή παραμείνει κρυμμένο.

- Κοιτάζοντας τον ιστό της εικόνας

«Σε περίπτωση αμφιβολίας, πρέπει να παρατηρήσετε την υφή της εικόνας (grain), που είναι προς το παρόν πολύ διαφορετική σε εικόνα ΤΝ από αυτήν μιας πραγματικής φωτογραφίας», δήλωσε στο AFP στις 22 Μαρτίου η Τίνα Νικούχα, διδάκτωρ στην επεξεργασία εικόνας στο εργαστήριο μαθηματικών του ENS Paris-Saclay.

Στις εκδόσεις των προγραμμάτων ΤΝ που κυκλοφορούν δωρεάν και δοκιμάστηκαν από το AFP, οι εικόνες που δημιουργήθηκαν είχαν ένα ύφος αρκετά παρόμοιο με τους πίνακες του υπερρεαλιστικού κινήματος, με έντονες αντιθέσεις, όπως αυτό το παράδειγμα κάτω αριστερά μιας εικόνας του «Μπραντ Πιτ στο Παρίσι» που δημιουργήθηκε στο Stable Diffusion.

Μια άλλη εικόνα που δημιουργήθηκε από το DALL-E με παρόμοιες λέξεις-κλειδιά κάτω δεξιά, είναι ωστόσο πιο πιστή και είναι λιγότερο εύκολο, εκ πρώτης όψεως, να πούμε ότι πρόκειται για εικόνα που δημιουργήθηκε από τεχνητή νοημοσύνη.

- Αναζητώντας οπτικές ασυμβατότητες

Παρά την αλματώδη πρόοδο που έχει σημειώσει ηΤΝ, παραμένουν πολλά λάθη στις εικόνες που δημιουργούνται με ΤΝ. Αυτά τα σφάλματα είναι, σε αυτό το στάδιο, ο καλύτερος τρόπος για να αναγνωρίσει κανείς μια κατασκευασμένη εικόνα, εξήγησαν οι ειδικοί που ερωτήθηκαν.

«Ορισμένα χαρακτηριστικά, που επαναλαμβάλονται συχνά τα ίδια, δημιουργούν πρόβλημα για την ΤΝ και είναι αυτές οι ασυμβατότητες και τα δημιουργήματα που πρέπει να εξετάζονται εξονυχιστικά, όπως σε ένα παιχνίδι με τις επτά διαφορές», δήλωσε ο Βίνσεντ Τεράσι.

«Ωστόσο, η ΤΝ βελτιώνεται μέρα με τη μέρα και παρουσιάζει όλο και λιγότερες ανωμαλίες, οπότε δεν πρέπει να βασιζόμαστε σε μακροχρόνιες οπτικές ενδείξεις», προειδοποιεί η Ανναλίζα Βερντόλιβα.

Για παράδειγμα, τον Μάρτιο του 2023, τα προγράμματα ΤΝ εξακολουθούν να δυσκολεύονται να δημιουργήσουν χέρια που να φαίνονται ρεαλιστικά. Αυτό αποδεικνύεται από το δυσανάλογα μεγάλο δάχτυλο του Μπραντ Πιτ στην εικόνα που δημιουργήσαμε παραπάνω, αριστερά. Το ίδιο σφάλμα εντοπίστηκε και στην εικόνα που δημιούργησε η ΤΝ για τον πυροσβέστη της ΕΜΑΚ στον σεισμό της Τουρκίας τον περασμένο Φεβρουάριο, όπου το χέρι του πυροσβέστη εμφανίζεται να έχει 6 δάχτυλα.

Ένα άλλο παράδειγμα είναι μια εικόνα που έχει κοινοποιηθεί παγκοσμίως, και η οποία έχει επαληθευτεί από το AFP, και δείχνει τον Πάπα Φραγκίσκο να φοράει ένα μακρύ, μοντέρνο λευκό σακάκι.

Το αριστερό του χέρι στην εικόνα είναι αφύσικο, με ορισμένα στοιχεία να είναι θολά και πολύ λεία, στοιχείο που μπορεί να υποδεικνύει ότι πρόκειται για εικόνα που δημιουργήθηκε από τεχνητή νοημοσύνη.

Μία από τις πρώτες εμφανίσεις αυτής της εικόνας μπορεί να βρεθεί στο Reddit την Παρασκευή 24 Μαρτίου.

Η διαδικτυακή πλατφόρμα BuzzFeed (αρχειοθετημένο εδώ) εξήγησε σε άρθρο της στις 27 Μαρτίου ότι επικοινώνησε με τον δημιουργό της εικόνας, κάποιον Πάμπλο Ξαβιέ από το Σικάγο, ο οποίος εξήγησε ότι δημιούργησε την εικόνα για να κάνει «αστεία πράγματα».

Σε μια σειρά φωτογραφιών, που φέρεται να τραβήχτηκαν κατά τη διάρκεια μιας διαδήλωσης κατά της συνταξιοδοτικής μεταρρύθμισης στις 7 Μαρτίου 2023 στην Γαλλία και δείχνουν έναν γάλλο αστυνομικό των CRS (στα γαλλικά τα ΜΑΤ) να αγκαλιάζει μια διαδηλώτρια, ένας δημοσιογράφος του AFP επισήμανε επίσης ότι ένας αστυνομικός είχε έξι δάχτυλα, αποκαλύπτοντας ότι επρόκειτο για μοντάζ.

The hand strikes again: these photos allegedly shot at a French protest rally yesterday look almost real – if it weren’t for the officer’s six-fingered glove #disinformation#AIpic.twitter.com/qzi6DxMdOx

— Nina Lamparski (@ninaism)

February 8, 2023

Σε ορισμένες από τις ψεύτικες φωτογραφίες της βίαιης σύλληψης του Τραμπ, τα πρόσωπα πολλών αστυνομικών είναι θολά και τα χέρια και τα πόδια των αστυνομικών εμφανίζονται εδώ και εκεί χωρίς συνοχή. Σε μία από αυτές, ο Ντόναλντ Τραμπ φαίνεται επίσης να φοράει ζώνη αστυνομικού.

«Προς τον παρόν, τα προγράμματα ΤΝ δυσκολεύονται να αναπαράγουν αντανακλάσεις. Ένας καλός τρόπος για να εντοπίσετε μια εικόνα ΤΝ είναι να ψάξετε για σκιές, καθρέφτες, νερό, αλλά και να κάνετε ζουμ στα μάτια και να αναλύσετε τις κόρες των ματιών, καθώς συνήθως υπάρχει αντανάκλαση όταν τραβάτε μια φωτογραφία. Μπορείτε συχνά να παρατηρήσετε ότι τα μάτια δεν έχουν το ίδιο μέγεθος, μερικές φορές με διαφορετικά χρώματα», λέει ο Βίνσεντ Τεράσι.

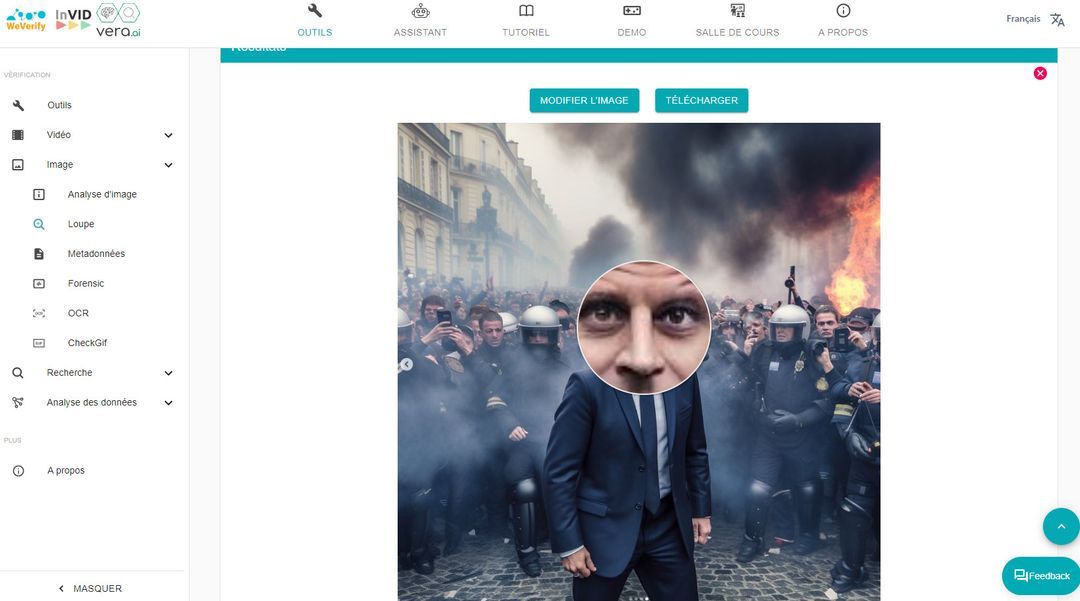

Αυτό συμβαίνει σε αυτή τη φωτογραφία του Εμανουέλ Μακρόν που δημιουργήθηκε με ΤΝ και κοινοποιήθηκε στο Instagram. Μια μεγέθυνση με το εργαλείο «μεγεθυντικός φακός» του προγράμματος Invid-WeVerify δείχνει ότι τα μάτια είναι καστανά και όχι μπλε. Επιπλέον, η απόχρωση του καφέ είναι διαφορετική μεταξύ των δύο ματιών.

Τα προγράμματα ΤΝ δημιουργούν επίσης συχνά ασυμμετρίες: πχ δυσανάλογο πρόσωπο, αυτιά σε διαφορετικό ύψος, σκουλαρίκια που λείπουν.

Η ΤΝ δύσκολα κάνει απομιμήσεις δοντιών και μαλλιών και παρατηρώντας την υφή τους και τον τρόπο που ξεχωρίζουν τα μαλλιά μπορεί να φανεί ότι πρόκειται για πλαστή φωτογραφία.

Μερικά στοιχεία μπορεί επίσης να μην είναι επαρκώς ενσωματωμένα, όπως τα γυαλιά ηλίου που θα τοποθετούνται σε ένα πρόσωπο.

Τέλος, η ανάμειξη πολλαπλών φωτογραφιών από την ΤΝ μπορεί να δημιουργήσει προβλήματα φωτισμού στην εικόνα, λένε οι ειδικοί.

- Ανιχνεύοντας το φόντο της εικόνας

Αξίζει να σημειωθεί ότι οπτικές ανωμαλίες κρύβονται συχνά στο φόντο της φωτογραφίας.

Στις φαινομενικά ρεαλιστικές εικόνες του Μπαράκ Ομπάμα και της Άνγκελα Μέρκελ στην παραλία που έχουν κάνει το γύρο των κοινωνικών δικτύων, το φόντο προδίδει ένα μοντάζ: ένα από τα άτομα στο φόντο έχει κομμένα τα πόδια του.

«Όσο πιο μακριά βρίσκεται ένα στοιχείο της εικόνας, τόσο περισσότερο ένα αντικείμενο θα είναι θολό, παραμορφωμένο και θα έχει λάθος προοπτική», συνεχίζει ο Βίνσεντ Τεράσι.

Στην ψεύτικη φωτογραφία της συνάντησης μεταξύ του Σι Τζινπίνγκ και του Βλαντιμίρ Πούτιν, μια κάθετη γραμμή της κολόνας στο βάθος δεν είναι ευθεία, το κεφάλι του Βλαντιμίρ Πούτιν φαίνεται δυσανάλογο με το υπόλοιπο σώμα του και αυτά τα στοιχεία προδίδουν ότι η εικόνα δημιουργήθηκε από ΤΝ, δήλωσε στο AFP ο Ντέιβιντ Φίσινγκερ.

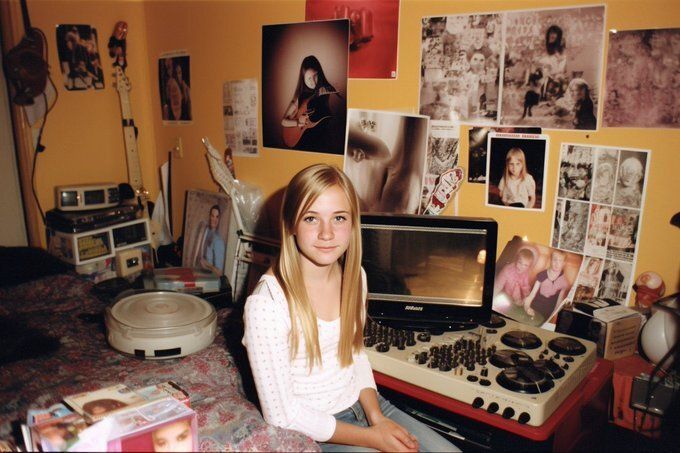

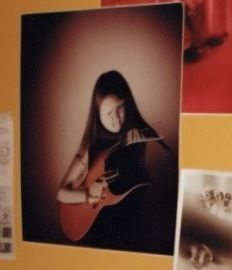

Ένα άλλο παράδειγμα είναι αυτή η εικόνα μιας έφηβης κοπέλας στην κρεβατοκάμαρά της. Με την πρώτη ματιά, τίποτα το ασυνήθιστο. Αλλά αν ρίξετε μια πιο προσεκτική ματιά στο φόντο, θα διαπιστώσετε πολλές παραξενιές και ασυμβατότητες: αντικείμενα που είναι αδύνατο να αναγνωριστούν, και πάνω απ’ όλα, παραμορφωμένα πρόσωπα σε όλες σχεδόν τις αφίσες στον τοίχο.

- Χρησιμοποιώντας την κοινή λογική

Αν και ορισμένα στοιχεία δεν είναι απαραίτητα παραμορφωμένα, μπορεί ωστόσο να μην φαίνονται λογικά και «καλό είναι να βασιστεί κανείς στην κοινή λογική» αν αμφιβάλλει για μια εικόνα, συνεχίζει ο Ντέιβιντ Φίσινγκερ.

Σε αυτή τη φωτογραφία, που δημιουργήθηκε από το AFP στο Midjourney και υποτίθεται ότι δείχνει το Παρίσι, μπορεί κανείς να δει, για παράδειγμα, μια μπλε πινακίδα απαγόρευσης, ένα μοντέλο σήμανσης που απλώς δεν υπάρχει στη Γαλλία.

Αυτό το στοιχείο, σε συνδυασμό με τα κομμένα δάχτυλα της κεντρικής φιγούρας, ένα κρουασάν που μοιάζει πλαστικό και ο διαφορετικός φωτισμός σε ορισμένα παράθυρα, υποδηλώνουν ότι η εικόνα αυτή είναι δημιούργημα ΤΝ. Το υδατογράφημα στην κάτω δεξιά γωνία της εικόνας αποδεικνύει αναμφίβολα ότι η εικόνα δημιουργήθηκε από το DALL-E.

Επιπλέον, ενώ η εικόνα που δημιουργήθηκε για αυτό το παράδειγμα υποτίθεται ότι έδειχνε τον Μπραντ Πιτ, το αποτέλεσμα δεν είναι πειστικό όσον αφορά την ομοιότητα.

Τέλος, αν μια εικόνα ισχυρίζεται ότι δείχνει ένα γεγονός αλλά υπάρχει αμφιβολία για την προέλευσή του, η καλύτερη μέθοδος είναι να αναζητήσετε πληροφορίες για να δείτε αν έχει αναφερθεί από αξιόπιστες πηγές και αν συνέβη πραγματικά, και αν ναι, να χρησιμοποιήσετε αυτά που έχουν αναφερθεί καθώς και τις υπάρχουσες εικόνες για να επισημάνετε πιθανές παρανοήσεις.

Για τη συνάντηση μεταξύ δύο πολιτικών ηγετών, αυτό θα μπορούσε να είναι, για παράδειγμα, ο τρόπος με τον οποίο ήταν ντυμένοι οι αρχηγοί των κρατών, οι συνθήκες του γεγονότος, ο καιρός εκείνη τη στιγμή, το σκηνικό ή οι εικόνες του πλήθους στο παρασκήνιο.